Daten im Warenhaus

Die Data-Warehouse-Anwendung Hive wurde in der Version 0.8.1 mit in die Distribution gepackt. Sie enthält nun endliche Zeitstempel und BLOBs als generische Datentypen, Bitmap-Indexes und Group-by-Optimierungen, um nur die wichtigsten Neuerungen zu nennen.

In einem aktuellen Release lässt sich auch Apache Pig mit der Clouder-Distribution installieren. Die Version 0.92.1 hinkt nur eine Versionsnummer hinter der aktuellen Apache-Version 0.10.0 her und enthält eine Reihe Verbesserungen gegenüber der letzten Version. So wurde die Interoperabilität zwischen Pig, Avro und HBase genauso verbessert wie die Loader- und Store-Funktionalität für die Verarbeitung von CSV-Dateien. Nützlich für größere Projekte, die mit Pig realisiert werden sollen, ist das Penny-Framework [6] , das sich für die Überwachung der Ausführung innerhalb eines Pig-Latin-Skripts eignet.

Zum Datenaustausch mit relationalen Datenbanksystemen (RDBMS) bringt Cloudera Sqoop in der Version 1.4.1 mit, das als Kommandozeilenwerkzeug Daten von und zu unterschiedlichen Systemen transferieren kann. Auf der Datenbank-Seite nutzt es dabei die von Java bekannte und leistungsfähige JDBC-Schnittstelle. Im aktuellen Release unterstützt es jetzt auch das Avro-Format. Damit lassen sich Datebank-Schemata in Avro-Schemata konvertieren und sogar komprimierte Avro-Datenströme verarbeiten.

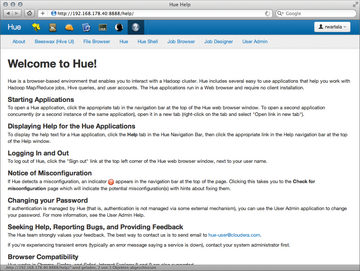

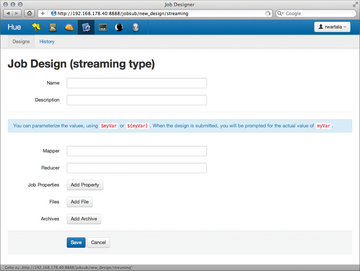

Etwas einfacher in der Handhabung ist das neue Hue (Hadoop User Environment, Abbildung 1 ) geworden, das ein Webbrowser-Frontend für die Nutzung von Hadoop bietet. Im Kern bietet das Tool einen (HDFS-)Dateibrowser, einen Job-Wizard zum einfachen Deployment von Map-Reduce-Anwendungen ( Abbildung 2 ) und mit Beeswax eine einfache Oberfläche, um CSV- und Excel-Dateien innerhalb von Hive nutzen zu können. Die Version 2.0 wurde vollständig neu und mithilfe von JQuery implementiert. Das ziemlich unschöne Namenode-Plugin für den Zugriff auf das HDFS wurde durch eine saubere WebHDFS/HttpFS-Implementierung ersetzt. Hue nutzt jetzt, wenn vorhanden, ein bestehendes LDAP-System, sodass die Nutzer-Authentifizierung zum Beispiel über OpenLDAP und Active Directory realisiert werden kann. Map-Reduce-Anwendungen werden nun über das Oozie-Workflow-Managementtool verarbeitet.

Inklusive Amazon

Apache Oozie ist mit Version 3.1.3 Teil der Cloudera-Distribution. Als wichtigste Neuerung ist hier die Verarbeitung von Hadoops neuen MRv2-Framework hinzugekommen. MRv2-MapReduce-Anwendungen lassen sich nun auch mithilfe von Apache Whirr in der Cloud betreiben, dank eines Updates auf Release 0.7.1. So lassen sich zum Beispiel mehrere Amazon-EC2-Instanzen mit wenigen Kommandozeilenaufrufen starten und fit für die Nutzung mit Hadoop machen.

Zu guter Letzt hat auch noch Apache Mahout, die Bibliothek für Algorithmen aus dem Bereich des Maschinellen Lernens, Eingang in Clouderas Distribution gefunden. In Version 0.6 sind einige neue Algorithmen für das Clustering und die Bayes Klassifikation dazugekommen.