Im Test: Nytro MegaRAID 8110-4i von LSI

Rennfieber

Die hier getestete Beschleunigerkarte für direkt verbundenen Storage (DAS) von LSI ist eine Kombination aus RAID-Controller und intelligentem Cache auf Flash-Basis. Direct Attached Storage kann damit um ein Vielfaches an Tempo zulegen, indem ein Algorithmus die häufig verwendeten Daten in den schnellen SSD-Cache verschiebt, wogegen seltener benutzte auf den relativ langsamen Platten bleiben. Auch der Rebuild einer RAID-Gruppe geht dank des Caches übrigens zügiger vonstatten.

An die Karte ( Abbildung 1 ) lassen sich direkt mittels eines SAS-to-SATA-Adapterkabels bis zu vier SATA-Festplatten anschließen. Alternativ lässt sich ein SAS-Expander konnektieren, der dann seinerseits mehr und schnellere SAS-Platten in einer internen Drive Bay ansteuern kann. Für diesen Test wählten wir die erste Option und verbanden drei SATA-Desktop-Platten von Western Digital mit der Karte, auf der sich außerdem zwei Flash-Module finden, die zusammen ein 90 GByte großes Volume bilden (CacheCade). Zum Vergleich maßen wir eine dieser Platten (WD3200BEKT) als Einzellaufwerk.

Unser Testrechner lief unter Windows Server 2008 R2, alternativ werden auch Windows Server 2003 SP2/XP SP2/Vista SP2 oder Windows 7 SP1 unterstützt, zusätzlich eine Reihe von Linux-Distributionen, darunter SLES und RHEL, außerdem VMware ESXi 4.x und 5 sowie Solaris 10 und 11.

Hürdenlauf

Die zu beschleunigenden Platten muss man im ersten Schritt zu einer RAID-Gruppe zusammenfassen. Das gelingt auf BIOS-Ebene entweder über eine einfache WebBIOS-GUI, die ohne Betriebssystemunterstützung auskommen soll, oder über ein Command Line Interface (CLI). Ersteres funktionierte auf unserem Rechner nicht. Das CLI, das wir notgedrungen wählen mussten, litt hingegen unter der Volkskrankheit der meisten Tools dieser Provenienz: benutzerunfreundliche Dokumentation samt kryptischer Syntax und nichtssagender Fehlermeldungen.

Beispielsweise muss der Anwender die Platten immer mit einer Enclosure- und einer Slot-Nummer spezifizieren, auch wenn sie gehäuselos verkabelt sind. Dann ist für das nicht vorhandene Enclosure ein Default-Wert von exakt 252 anzugeben, was die Dokumentation aber mit keiner Silbe erwähnt. Erraten kann man es jedoch auch nicht. Wer es etwa mit Enclosure 0 oder 1 versucht, was noch einigermaßen nahe liegen würde, der erhält stets die vielsagende Fehlermeldung "Invalid input", mit der ausnahmslos jede Art von Tipp-, Syntax-, oder Sachfehler schmallippig quittiert wird. Ohne Hilfe des Support ist man hier chancenlos.

Als zusätzliche Verwaltungsalternative lässt sich unter Windows ein MegaRAID Storage Manager installieren, der viele Einstellmöglichkeiten bietet, den Status reportiert und einen Blick ins Log des Controllers erlaubt. Allerdings kann man mit ihm zwar das Volume für den SSD-Lesecache konfigurieren, wir haben aber kein Monitoring gefunden, das beispielsweise eine Cache Hit Ratio ausgewiesen hätte.

Beim Storage Manager sollte man außerdem unbedingt auf eine aktuelle Version achten (derzeit 12.x), denn ältere Versionen können den Flash-Cache nicht managen. Legt man mit ihnen (oder mit dem CLI) eine neue RAID-Gruppe an, ist der Cache ausgeschaltet und die veraltete Software weist weder darauf hin noch bietet sie eine Option an, um ihn zu aktivieren, noch ein Monitoring, das den Fehler aufdecken würde. Die RAID-Konfiguration funktioniert, aber ohne Cache und mithin ohne entsprechenden Performance-Vorteil. Erst neuere Versionen der Management-Software erlauben es dem Admin, den Cache einzuschalten.

Benchmarks

Ist alles glücklich eingestellt, braucht das Betriebssystem noch einen passenden Treiber und dann kann es losgehen. Eine erste überschlägige Messung ergab im Vergleich der RAID-Gruppe (zunächst ohne Cache) zu einer Einzelplatte, die mit den im RAID verbauten identisch war, einen Geschwindigkeitszuwachs maximal um den Faktor drei, der allein auf die Verteilung der Lesezugriffe durch das RAID5 auf mehr Spindeln zurückzuführen ist.

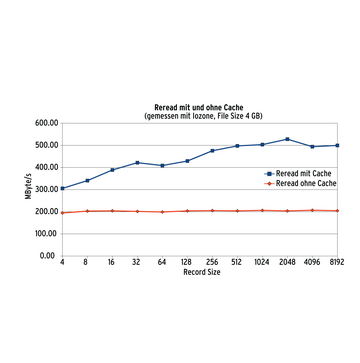

Mit zugeschaltetem Cache ergaben sich beim sequentiellen Lesen Geschwindigkeiten bis knapp 600 MByte/s, was noch einmal einer Verdreifachung gegenüber den Leseleistungen des unbeschleunigten RAID 5 entspricht. Ein ähnliches Ergebnis liefert die Reread-Funktion für wiederholtes Lesen ( Abbildung 2 ): Bei großer Record Size klettern die Werte bei wahlfreien Zugriffen über 500 MByte/s und über 50 000 IOPS.

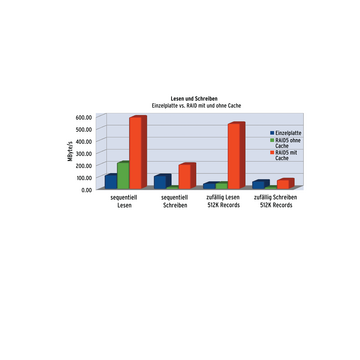

Vergleicht man ein paar der Benchmark-Resultate ( Abbildung 3 ), zeigt sich, dass der Charakter des Workloads eine große Rolle spielt. Dominiert das wahlfreie Schreiben kleiner Records, kommt die Performance auch mit dem Cache kaum aus dem Keller. Beim sequentiellen Lesen oder beim zufälligen Lesen möglichst großer Rekords kann sich dagegen der Durchsatz gegenüber einer Einzelplatte verfünf- oder -sechsfachen. Gegenüber einer RAID-Gruppe ohne Cache verdreifacht sich immerhin die Leseleistung in der Spitze.