Analyzer für Webserver-Logdateien

Volkszählung

Webserver sind äußerst redselige Gesellen. Jede noch so kleine Anfrage protokollieren sie minutiös in einer Textdatei. In diesem Logfile landen neben der IP-Adresse des anfragenden Rechners mindestens noch der Name der ausgelieferten Datei, die dabei übertragenen Bytes, sowie Datum und Uhrzeit des Zugriffs. Mit diesen Informationen in der Hand wird die Erstellungen einer Besucherstatistik zum Kinderspiel: Flugs die Zugriffe auf eine Unterseite zusammengezählt und schon hat man dessen Besucherzahlen.

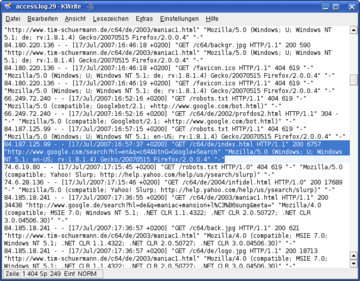

Wer jetzt jedoch eifrig die Logdateien auf seinem Webserver aufspürt und in einem Editor öffnet, den begrüßt eine recht kryptische Textwüste, ähnlich wie die in Abbildung 1 . Jede Zeile entspricht genau einer Anfrage, die Bedeutung der darin gespeicherten Daten erschließt sich jedoch häufig erst auf den zweiten Blick, wenn überhaupt. Wer Herr über seinen eigenen Webserver ist, bestimmt in dessen Konfigurationsdateien, welche Daten in welcher Reihenfolge im Logfile landen. Vielen preiswerte Hosting-Pakete verhindern jeden Einfluss auf den Dateiaufbau (siehe dazu den Kasten "Selbsthilfe" ).

Selbsthilfe

Einige Webhoster mogeln in die Logfiles noch die Angabe des virtuellen Serves, an den die jeweilige Anfrage gerichtet war. Damit verändern sie jedoch das ansonsten standardkonforme Format und bringen so die Analyzer ins straucheln. Beispielsweise setzt 1&1 in seinen günstigen Shared-Hosting Paketen auf das Combined Log Format, schmuggelt aber in jede Zeile noch die Domainnamen des Servers mit hinein. In solchen Fällen kann man den Analyzern entweder das Format beibringen oder kurzerhand die zusätzlichen Informationen entfernen. Das geht beispielsweise recht schnell per sed:

sed 's/ www.meineseite.de / /g' access.log > manipulierte.log

entfernt den Domainnamen

»www.meineseite.de«

aus dem

»access.log«

. Wichtig sind dabei die Leerzeichen, da ansonsten der Domainname auch aus den eigentlichen Anfragen gestrichen würde.

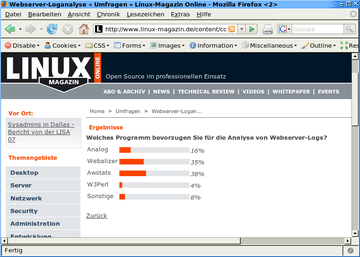

Auf dem Markt buhlen eine fast schon unüberschaubare Fülle von kostenlosen und kostenpflichtigen Analyzern um die Gunst der Administratoren. In den meisten Fällen kann man seine Geldbörse jedoch stecken lassen: Wie folgende Auswahl der beliebtesten Open-Source-Werkzeuge beweist, haben sie einiges auf dem Kasten. Abbildung 2 zeigt die Ergebnisse einer Umfrage, die das Linux-Magazin-Online durchgeführt hat [2] . Dieser Artikel vergleicht die wichtigsten Analysatoren und beschreibt, wie der Admin sie installiert und verwendet.

Abbildung 2: Das Ergebnis einer Online-Umfrage des Linux-Magazins über die beliebteste Weblog-Analysesoftware.

Abbildung 2: Das Ergebnis einer Online-Umfrage des Linux-Magazins über die beliebteste Weblog-Analysesoftware.

Textinterpretation

Weblog-Analyzer spucken nicht nur nette Statistiken aus, sondern helfen dabei, den eigenen Auftritt zu verbessen, erlauben Rückschlüsse auf das Surfverhalten der Besucher und geben sogar Hinweise auf Einbruchsversuche. Wenn die Analyseergebnisse vorliegen, sollte der erste Blick immer auf die Liste mit den nicht erreichbaren Seiten fallen. Jede hier auftauchende Datei steht für Links, die ins Leere führen. Benutzer reagieren auf solche Sackgassen häufig genervt und verlassen in vielen Fällen gleich die Website. Einen Spezialfall bilden die von Suchmaschinen erwarteten Hilfsdateien, wie die bekannte

»robot.txt«

[1]

. Wer diese nicht benötigt, kann Google und Co einfach einen leeren Dummy vor die Nase setzen.

Weiter geht es bei der Liste mit den beliebtesten Unterseiten – und zwar an dessen Ende. Meiden die Besucher beispielsweise eigentlich wichtige Teile der Homepage oder betreten diese nur recht selten, sollte man sich dringend überlegen, warum das so ist und wie man sie wieder dorthin lockt. Beispielsweise könnte man auf den beliebtesten Seiten entsprechende Links oder Hinweise platzieren. Besser und intelligenter wäre hingegen eine Anpassung der gesamten Site-Struktur und der Benutzerführung. Einige Analyzer liefern unterstützend noch eine Liste mit Seiten, über die der Besucher in den Internetauftritt eingestiegen ist. Nach einer Umgestaltung der Seite klären die Statistiken zudem die Frage, ob die Besucher das neue Design annehmen und die Besucherströme konstant bleiben.

Angriffe entdecken

Tauchen in den Statistiken Dateien auf, die eigentlich nicht auf dem Webserver liegen sollten, ist dies ein erstes Indiz für einen Einbruchsversuch oder gar Missbrauch. Man sollte hier insbesondere Dateien im Auge behalten, auf die ein (direkter) Zugriff eigentlich verboten ist. Beispielsweise darf ein Content Management System seine PHP-Skripte ausschließlich selbst aufrufen. Tauchen nun dessen Dateien dennoch in der Statistik auf, sollten bei einem verantwortungsvollen Administrator gleich mehrfach die Alarmglocken schrillen – und das besonders laut, wenn die Dateien in der Vergangenheit obendrein noch durch Sicherheitslücken aufgefallen sind.

Ein Webserver, der etwas auf sich hält, speichert zusätzlich zu den trivialen Daten noch die Kennung des zugreifenden Browsers (der so genannte User-Agent) und die vom Benutzer zuvor besuchte Website (der so genannte Referrer). Mit diesen Daten lässt sich beispielsweise Darstellung der Webseite auf den meist genutzten Browser optimieren. Die Referrer geben schließlich noch Auskunft darüber, von welchen Seiten die Besucher vorwiegend auf die eigene Homepage finden. Dies ermöglicht beispielsweise gezieltere Werbekampagnen. Besonders interessant sind Referrer, die aus Suchmaschinen stammen. Einige Analyzer lösen aus diesen URLs die verwendeten Suchbegriffe heraus. Die entsprechenden Wörter dienen dann wiederum als Basis für Metatags oder andere Mechanismen zur Suchmaschinenoptimierung (SEO).

Last but not least gibt die Anzahl der übertragenen Bytes darüber Aufschluss, wie gut der Webserver ausgelastet war. Eventuell lohnt es sich sogar, einen zweiten Server für einen Teil des Interentauftritts abzustellen und so den Hauptserver zu entlasten. Mieter eines Hosting-Pakets mit limitiertem Übertragungsvolumen wissen die Zahlen ebenfalls zu schätzen, sehen sie doch auf diese Weise schnell, ob die maximal Obergrenze bald erreicht ist oder gar teuere Strafzahlungen fällig werden.